Avid propose un document de référence sur l’avenir de la postproduction en Ultra HD et 4K,

les solutions Avid actuelles et futures, 2K, 4K et Ultra HD.

Ce livre blanc est hélas en anglais.

Nous vous proposons cette version française, traduite et adaptée du livre blanc Avid…

Workflows Avid Haute Résolution

2K, 4K et UHDTV

Introduction

Ce document commence par un tour d’horizon des standards émergents en UltraHD, suivi par une discussion sur les problématiques, les solutions et les bénéfices de l’intégration de médias HD dans les workflows existants de postproduction et broadcast.

Aperçu

A l’heure où le prix des TV « 4K » descendent sous la barre des 4000 Euros, il est progressivement clair que, même si la HD n’a pas encore atteint certaines zones, c’est une actualité ancienne pour les fabricants et les lanceurs de tendance dans le monde des produits électroniques. Tout le monde a son opinion sur les avantages relatifs d’écrans de plus haute définition, de « on ne voit pas la différence » jusqu’à « ça change toute la donne ». Bien que le terme 4K soit souvent utilisé pour parler d’un ensemble de formats HD, on ne voit aucune raison que les résolutions s’arrêtent à 4K.

Si la plupart des productions numériques supérieures à la HD sont tournées simplement en 2K, il faut noter que les normes internationales ont déjà prévu d’autres choses que du 3840 par 2160 pixels (la définition de l’Ultra HD).

En terme de 2K/4K, il y a de nombreuses variantes : les résolutions de scan cinéma numérique, comme 4096×3112 et le DCI (Digital Cinema Initiative), DCI 4K (4096×2160) ou DCI 2K (2028×1080), ainsi que les sorties DCP (Delivery Cinema Package), utilisées depuis des années comme des standards. Au lieu de nous focaliser sur les pratiques établies dans le cinéma, regardons les nouveaux workflows broadcast, dénommés Ultra HD (ou UHDTV), que les constructeurs TV et les diffuseurs broadcast appliquent sous le nom de 4K.

La UHDTV est en fait un ensemble de standards haute résolution proposés par la NHK (télévision japonaise) et ensuite approuvés par l’ITU (Union Internationale des Télécommunications) en août 2012, sous la spécification BT-2020 ITu-R Recommendation).

Ce n’est pas un hasard si la version UltraHD du 4K est en fait du 3840×2160 : ce nombre de pixels est exactement 4 fois celui de la HD (1920×1080) et correspond parfaitement à l’aspect 16/9. Même si certains peuvent arguer que ce n’est pas du « vrai » 4K, le maintien de la compatibilité avec le 16/9 existant est un facteur primordial qui sinon aurait compromis l’adoption du nouveau standard.

En plus de la résolution spatiale, des changements sont proposés en UHDTV, en cadences d’images et en codage couleur. Toutes ces propositions appartiennent actuellement à une « phase d’approche » de l’ITU et de la SMPTE pour faire de la UHDTV une réalité pratique pour les fabricants, les distributeurs et les consommateurs.

UHDTV-Phase 1 (2014/2015)

La première phase de l’UHDTV proposait ces caractéristiques :

- Cadence maximale 60 im/sec (uniquement en progressif)

- Résolution jusqu’à 4K (3840×2160)

- Couleur en 10 ou 12 bits (mais plus jamais de 8 bits)

- Espace couleur Bt 2020 ou 709

- Compression HEVC

- Audio 5.1 et 7.1

La phase 1 de l’UHDTV est surtout du Quad HD (4 images 1920×1080, assemblées).

Plus intéressante à court terme est l’émergence de formats uniquement progressifs. Tout le monde s’accorde sur le fait que les formats entrelacés ont dépassé leur espérance de vie, et que le 60P (ou 50p) représente les programmes en mouvement, comme le sport, beaucoup mieux que tout ce que nous avons vu jusqu’à maintenant.

L’autre changement significatif concerne l’espace couleur et sa profondeur. Alors que le standard HD Rec 709 est limité à une profondeur 8 ou 10 bits, le Rec 2020 élimine le 8 bits, et ne supporte que 10 ou 12 bits.

L’augmentation de la gamme de couleurs obtenue pourrait être une amélioration de qualité très visible, mais quelque peu difficile à préserver jusqu’au consommateur, induisant des dépenses techniques sur tout le chemin de la diffusion.

Le support d’une gamme de couleurs élargie ou d’une cadence progressive plus élévée pourrait améliorer le visionnage HD actuel sur un écran UHDTV, tout en attendant que les résolutions 4K deviennent la norme.

UHDTV-Phase 2 (2015)

La phase 2 de l’UHDTV ajoute ces possibilités :

- Cadences augmentées jusqu’à 120Hz

- Vidéo HDR (high dynamic range)

- Audio avancé

UHDTV-Phase 3 (2020, JO de Tokyo)

La phase 3 ajoute :

- Résolution « 8K » 7280×4320 (format japonais « Super High Vision »)

Dans la phase 2 de l’UHDTV, les cadences sont encore augmentées, apportant encore plus de bénéfices aux sports et à l’action rapide.

Pour les récalcitrants de la 3D, une image réellement à 120 images/secode crée une expérience 3D vraiment améliorée.

Le High Dynamic Range ferait une grosse différence sur l’écran du consommateur, produisant plus de contraste et préservant la luminosité d’une scène réelle. Des fabricants de caméras comme RED et Arri ont déjà développé des capteurs pouvant saisir des images HDR.

On note également la technologie Dolby Vision, qui montre clairement qu’une image disposant d’une dynamique plus importante est préférée par la plupart des spectateurs, davantage qu’une simple densification des pixels.

Même si les formats audio proposés par l’UHDTV ne sont pas le sujet de ce livre blanc, il est facile d’imaginer les problématiques engendrées par le passage au surround 5.1 et 7.1. Des propositions comme celle de Ambisonics (Scene Based) et des technologies propriétaires comme celle de Dolby (Atmos) sont l’objet de discussion.

Finalement, dans la phase 3 de l’UHDTV, le support du 8K (7280×4320) est ajouté à cause des JO de 2020, que la NHK prévoit de diffuser en 8K. Manifestement le 8K ne concerne personne dans le monde, mais il fait partie des spécifications et deviendra réel dès lors que la technologie deviendra abordable.

Travailler avec des médias haute résolution

La UHDTV arrive, par phases, mais elle arrive, pour satisfaire tous les consommateurs.

La résolution seule (HD vers 4K/8K) peut avoir du mal à rivaliser avec l’amélioration révolutionnaire qu’a été le passage de la SD à la HD pour les spectateurs. Mais, avec l’ajout de cadences plus élevées, de gammes de couleurs plus larges et d’une dynamique accrue, la UHDTV représente une étape susbtantielle dans l’évolution des médias numériques.

Pour les organisations spécialisées dans les médias, cette prochaine étape présente des problématiques importantes, pour la distribution et la monétisation du contenu, et elle cassera probablement le modèle des infrastructures traditionnelles de diffusion et distribution. Cependant, bien que les pôles de distribution et de consommation de la haute résolution en soient encore à leurs débuts, l’industrie de la production et de la postproduction a déjà mis en place les workflows possibles, et a activement cherché à recueillir les bénéfices du travail des images en haute résolution, dans l’environnement actuel de postproduction, tout en gardant à l’esprit l’évolution de la UHDTV.

Les bénéfices de la postproduction avec des images haute résolution

Même si la plupart des spectateurs sont incapables de voir la différence entre HD et 4K, à 3 mètres de leur écran 50 pouces, le travail en hautes résolutions apporte des bénéfices énormes, et ce n’est pas un secret pour les professionnels qui créent aujourd’hui des contenus irrésistibles.

Pourquoi tourner en résolutions supérieures à la HD, lorsque la diffusion finale est HD ?

Au fur et à mesure que les caméras à cartes et en haute résolution deviennent abordables, l’une des raisons pour lesquelles des productions ont choisi d’acquérir en résolutions plus élevées consiste à capter une performance dans la meilleure qualité possible, et ainsi sécuriser les investissements futurs. Bien que l’archivage de ces gros fichiers représente ses propres problématiques, c’est une décision très sage qui aide les créateurs de contenu à allonger la durée de vie de ces médias.

Basé sur des fichiers, le média de haute résolution est un complément naturel au montage numérique et à l’équipement de stockage, même si l’infrastructure nécessaire pour lire de manière fluide des fichiers aussi gros peut impliquer un investissement conséquent. De loin, le plus grand bénéfice de l’acquisition d’images haute résolution est la flexibilité accrue et le contrôle obtenu en postproduction. Avec des exigences de diffusion broadcast toujours en HD (pour un certain temps), des images 2K, 4K ou 5K nécessitent d’être retraitées pour en extraire une image HD. Avoir 4 fois les pixels nécessaires autorise une grande flexibilité pour décider quelle portion d’image afficher en HD. Un monteur peut panoramiquer dans une image, ajoutant un mouvement au plan, ou zoomer dedans, sans aucune perte de qualité. Avec une source HD, un tel zoom peut être difficile, la faible résolution produisant une qualité d’image trop faible.

A côté des résolutions spatiales, il y a des gammes de couleur et des échelles de dynamique disponibles grâce à ces caméras. Les caméras HD courantes sont limitées à une profondeur couleur de 10 bits, alors que les caméras de résolution supérieure fournissent en général une couleur sur 12 bits voire 16 bits. Les cinéastes peuvent utiliser des techniques comme le HDR pour capturer la lumière d’une façon spectaculaire et attribuer aux images des styles qui seront maintenus durant toutes les étapes de postproduction. Cette dynamique augmentée fournit à l’étalonneur plus de latitude pour changer le look final de l’œuvre, en terme de contraste et de couleur, sans perte de détail ni introduction de bruit.

De nombreux diffuseurs (câble et satellite) continuent d’exiger une sortie sur cassette de leurs shows, et malgré les limites de la cassette, celle-ci est assez facile à gérer en terme de production et de système d’archivage. Lorsqu’un monteur ou un assistant a fait une cassette, on la pose sur une étagère avec une note descriptive.

Les médias sous forme de fichiers sont appréciés pour la facilité de duplication et distribution électronique, et leurs fonctionnalités dépassant le temps réel. Mais, avec leurs différents formats et codecs, les monteurs sont souvent obligés de transcoder la plupart des médias en codec/format usuel. Egalement, les médias sous forme de fichiers sont parfois difficiles à gérer et à archiver, en comparaison des cassettes et de la logique « tu la vois, tu n’y penses plus ».

Ces corvées de querelles numériques prennent un temps couteux au processus créatif en postproduction. Un objectif central est donc d’automatiser et réduire autant que possible ces travaux non créatifs, pour les monteurs et les assistants, et envoyer ces processus en arrière-plan, pour libérer monteurs et assistants afin qu’ils continuent d’utiliser leurs talents à raconter de puissantes histoires.

Minimiser l’impact de la haute résolution dans des workflows efficaces

Les environnements de production professionnels comprennent la plupart du temps des équipes créatives collaborant ensemble sur un ou plusieurs projets. Monteurs image, ingénieurs du son, truquistes… tous collaborent pour finaliser une production de haut niveau, aussi rapidement que possible, en optimisant les investissements faits par la société dans les outils et les personnes.

Travailler avec la plus haute résolution possible est une nécessité en effets spéciaux, étalonnage et dans les processus de finishing (la finalisation).

Cependant, pour les fonctions centrales de narration, comme le montage, le dérushage, la visualisation et l’approbation, des fichiers haute résolution sont trop gros et immobiliseraient la productivité lorsqu’il faut déplacer les fichiers entre collaborateurs, et ils ajouteraient un fardeau de plus pour les stations de travail et pour les exigences de stockage.

Ainsi, il est parfois important de pouvoir mettre entre parenthèses les bénéfices des médias haute résolution, pour ne pas ajouter des contraintes supplémentaires aux processus économiquement efficaces, dans un certain nombre d’activités : collaboration, gestion des données, montage à distance, archivage, allègement des médias, optimisation des performances éditoriales.

Le maintien de cette efficacité est le but fondamental de toute activité économique, et c’est le cœur de la plateforme des médias conçue par Avid.

AMA et DMF

La première étape pour travailler effiacement avec des médias haute résolution est de décider de travailler en résolution native, ou de transcoder en un codec intermédiaire ou adapté aux processus de postproduction efficaces. La décision peut dépendre du format de sortie finale, le workflow mis en place par le studio de postproduction, ou la rapidité exigée par la partie éditoriale. L’étape suivante est de maintenir le lien avec les médias source, pour un accès instantané.

Dans les systèmes Avid, cela se fait en utilisant AMA (Avid Media Access). AMA est un standard de plug in ouvert développé par Avid, et utilisé par les principaux constructeurs de caméras, afin de faciliter un accès instantané aux médias originaux et aux métadonnées de la caméra.

AMA diffère de la fonctionnalité d’autrefois, l’import, pendant lequel monteurs et assistants attendaient que le média soit importé et transcodé, ou ré-empaqueté en format MXF. Tandis qu’un format intermédiaire comme le Avid DNxHD a de nombreux avantages, lire et monter directement à partir des médias natifs de la caméra, sans attendre un import très long, est une première étape importante pour organiser effiacement les contenus. AMA permet cet accès instantané et apporte également toutes les métadonnées associées aux médias. La seule manière d’améliorer un tel processus aussi fluide serait de l’automatiser et de le faire en tâche de fond : transcoder, copier, consolider les médias…

Heureusement, cette possibilité existe dans une nouvelle fonction appelée Dynamic Media Folders (DMF) (dossiers média dynamiques), une nouvelle fonction importante de Media Composer 7.

Dynamic Media Folders, les dossiers dynamiques

Le but principal des dossiers média dynamiques (DMF, dynamic media folders) est de permettre aux utilisateurs de calculer et organiser automatiquement les médias basés sur des fichiers, en tâche de fond, éliminant ainsi un processus typiquement fastidieux, et source de perte de temps.

Des processus automatisés sont précieux pour créer des médias HD proxy à partir de sources haute résolution, lesquelles peuvent être un obstacle à des performances temps réel acceptables, au travail en équipes parallèles, à la collaboration à distance ou à l’espace de stockage.

Monteurs et ssistants peuvent organiser leurs médias dans des dossiers qui seront gérés et scrutés, en sachant que les médias seront automatiquement traités selon un réglage personnalisé.

Des éléments dans un DMF peuvent être automatiquement :

- copiés à un autre endroit, et reliés

- transcodés

- consolidés

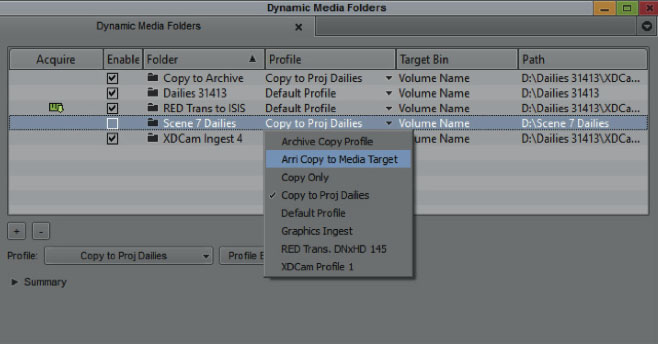

L’interface DMF propose de régler un « profil » pour décrire la tâche désirée :

- Les utilisateurs peuvent créer des profils multiples pour décrire les actions qui surviennent au média lorsqu’il arrive dans un dossier défini. Ces profils peuvent facilement être copiés et partagés. Voir la figure 1.

- Tous les processus surviennent en arrière plan, avec les ressources système disponibles. Ils agissent sans lien avec le lancement ou non de Media Composer

- Le monteur n’est pas interrompu ou distrait par des barres de progression ou des notifications.

- Les éléments dans les dossiers DMF sont « gérés », c’est-à-dire indexés par le système et trackés, pour réduire le risque qu’un média devienne non lié, donc « offline ».

- Les utilisateurs peuvent, s’ils le désirent, surveiller la progression des tâches en arrière plan dans une fenêtre « file d’attente » (background queue)

L’utilisateur attribue un profil au dossier DMF, en lui donnant des caractéristiques uniques, comme Copy, Consolidate, Transcode, et la manière dont ces clips vont s’intégrer aux bins.

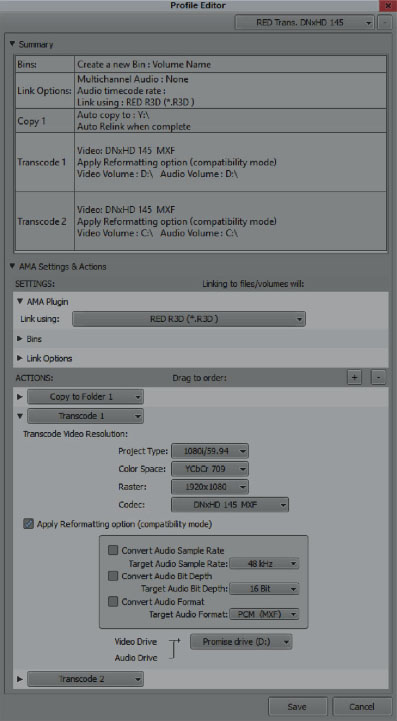

Ces réglages et ces actions sont créés en utilisant le Profile Editor (Figure 2), qui établit des réglages de lien AMA et assigne les opérations de Copy, Consolidate ou Transcode afin que tout fichier ou volume placé dans le DMF soit calculé correctement.

Dans le cas de médias haute résolution, un workflow commun pourrait être utilisé pour que les DMFs transcodent automatiquement les médias en format proxy, par exemple du DNxHD 36 en workflow éditorial, pour minimiser l’impact sur les performances et les débits, pour chaque utilisateur sur le réseau.

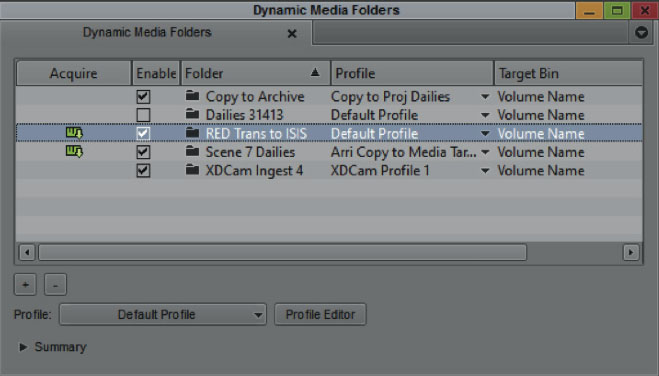

Dès lors que les fichiers ont été déposés dans un dossier DMF et/ou calculés, l’utilisateur est prévenu dans la timeline que les nouveaux éléments sont prêts à être acquis.

Lorsque la fenêtre DMF est ouverte, l’utilisateur voit quels DMFs contiennent les nouveaux éléments.

Cliquer le bouton vert de la bin (colonne « Acquire ») va amener les nouveaux éléments dans Media Composer en remplissant une bin basée sur les réglages AMA associés au Profil (Figure 3). De cette manière, le monteur n’est pas perturbé et peut choisir le meilleur moment pour faire l’acquisition de tout nouveau média qui a été calculé en arrière plan.

Tous les fichiers sont placés dans le DMF qui apparaîtra dans Media Composer en tant que masterclip AMA.

Une fois le média transcodé en plus basse résolution, les liens aux sources d’origine haute résolution subsistent, permettant de relier (re-link) à la version haute rés., au moment nécessaire, notamment en étalonnage et finalisation.

Sortir des masters HD à partir de médias haute résolution : FrameFlex

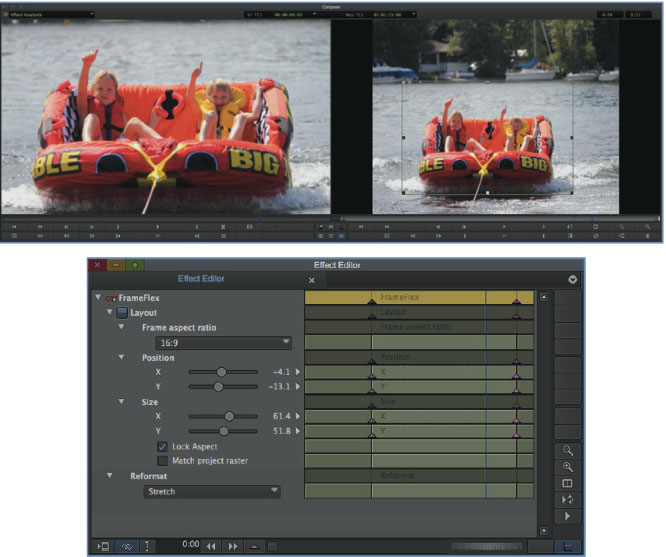

Comme vu précédemment, des productions tournent fréquemment en résolutions supérieures à la HD (2K, 4K, 5K, etc) car cela leur donne le contrôle ultime en postproduction, pour prendre des décisions de recadrage, couleur et qualité. Cependant, la majorité des productions hors cinéma ont toujours besoin de sortir des masters HD. Reconnaissant cette orientation, Avid a introduit l’outil FrameFlex dans Media Composer 7.

Avant Media Composer 7, il était possible d’afficher des images plus grandes que la résolution du projet, avec l’option reformat. Le média était déformé, redimensionné, ou rogné. Cependant, il n’y avait pas moyen de sélectionner une zone précise (region of interest) du média pour qu’il devienne le nouvel élément image recadré. En utilisant FrameFlex, les monteurs peuvent désormais contrôler avec précision quelle zone de leur média haute résolution (vidéo ou images fixes) sera extraite pour une sortie HD. En utilisant l’éditeur d’effets (effect editor), il est également possible d’animer la zone de découpe dans le temps, pour panoramiquer et zoomer à travers une image. Ce cadrage sélectif permet au monteur de focaliser l’attention du spectateur tout en préservant la résolution de l’image source. C’est non destructif et modifiable à tout moment.

Selon certains monteurs, les productions tournent désormais « large » en sachant que FrameFlex sera utilisé pour recadrer en postproduction. Ce workflow double ainsi le nombre d’angles de caméra utilisables.

Les métadonnées FrameFlex restent avec l’élément : en cas de changement de résolutions durant un relink, les données de recadrage restent intactes. Pour le finishing, cela garantit que l’image finale sera toujours produite à partir de la plus haute qualité d’image source.

Cadence d’image : mélange et correspondance…

Les projets sont rarement acquis dans un format unique et une cadence unique.

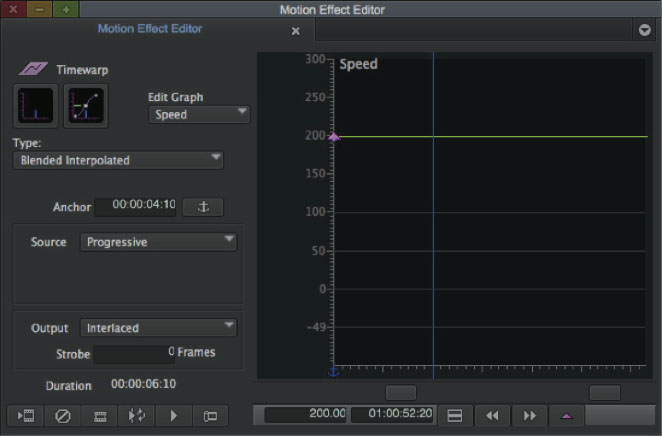

La fonctionnalité mix-and-match de la timeline de Media Composer permet aux monteurs de se concentrer sur leur récit en appliquant l’adaptateur de mouvement correct (motion adaptor) à tout média à la cadence différant du projet, pour un résultat temps réel de haute qualité. Si certains résultats ne correspondent pas encore à ce que le monteur recherche, le logiciel permet à celui-ci de personnaliser le processus d’adaptation de vitesse pour obtenir le look recherché (Figure 4).

Gestion de la couleur – CDLs et LUTs

Comme mentionné précédemment, avec l’utilisation de caméras modernes à fichiers numériques, la haute résolution ne fait pas que capturer plus de pixels, mais propose aussi de capturer une couleur améliorée, de même pour le détail du contraste, avec une plus grande dynamique. Le but de tout système de prise de vues est de mimer davantage la gamme de perception visuelle de l’œil humain, en termes de contraste et de couleur. Puisque l’œil humain ne « grille » pas les blancs ni « n’avale » les noirs comme une caméra peut aisément le faire, les fabricants ont créé des solutions pour stocker les données image du capteur où davantage de ces détails seront conservés. On trouve un certain nombre de méthodes pour faire cela, et par conséquent, les constructeurs de caméras encodent dans différents espaces couleur: Arri Log-C, Canon C-log, Sony Slog2.

Si les consommateurs risquent de voir les couleurs correctes sur leurs écrans HD, ces espaces couleurs alternatifs ont besoin d’être redistribués sur l’espace couleur HD (Rec. 709).

Pour un monteur ayant besoin de se concentrer sur une histoire passionnante, l’idéal serait que le système de montage détecte l’espace couleur des médias source et sélectionne automatiquement l’espace couleur correct pour la sortie. La gestion de couleur est essentielle pour garantir que les couleurs correctes seront préservées et maintenues tout le long du pipeline de production et de postproduction. Une partie de l’encodage couleur inclut les LUTs (look up tables, tables de correspondance colorimétrique) qui peuvent être distribuées avec le média, pour garantir que la bonne couleur est bien appliquée à tous les rushes concernés. Le système de gestion couleur prendra les couleurs d’une image et les re-mappera (les redistribuera), aussi précisément que possible, vers le modèle couleur choisi pour le processus de montage. Ce mapping color est soit effectué à la volée, soit calculé sur les médias après application des effets.

Dans Avid Media Composer, lorsque cette information couleur est intégrée aux métadonnées du fichier fabriqué par la caméra, elle peut être mappée automatiquement vers l’espace couleur HD Rec 709. Non seulement cela fait gagner du temps, mais cela garantit au monteur et à l’assistant un choix pertinent. Sinon, une LUT peut aussi être insérée comme look manuel, par le directeur photo. Par ailleurs, l’information couleur peut être transmise par une Color Decision List (CDL) en important un fichier Avid ALE (Avid Log Exchange) ou en entrant manuellement les données. On peut appliquer davantage qu’une LUT, et pour cette raison on peut changer l’ordre d’application des LUTs, avec un résultat visuel final différent. Durant ce processus, les données couleur d’origine sont conservées avec les métadonnées des médias master tout le long du processus de montage.

Infrastructure

Comme le stockage partagé et la gestion des données sont deux composantes importantes des workflows de postproduction, on peut facilement imaginer l’impact négatif de fichiers haute résolution sur une telle infrastructure, en terme d’espace de stockage consommé et d’impacts sur sa performance.

Les environnements professionnels de postproduction ainsi que les diffuseurs comprennent les bénéfices du travail en équipe en parallèle sur le même projet, et il est important de ne pas sacrifier cet avantage uniquement pour utiliser des médias haute résolution.

Les sociétés cherchent ainsi des solutions pour leurs workflows haute résolution, au sein de leurs infrastructures actuelles.

Avid ISIS et Avid Interplay sont des systèmes de stockage intelligent et de gestion de données actuellement en service dans des milliers de sociétés dans le monde entier. Constatant que les fichiers haute résolution peuvent devenir un fardeau pour les réseaux, la plupart des utilisateurs choisissent de transcoder en résolution proxy pour les workflows éditoriaux. Que cela soit en Avid DNxHD, Apple ProRes ou même en résolution SD, Avid Interplay peut transcoder en tâche de fond, pour que les monteurs continuent de travailler. Un problème fréquent avec les gros fichiers est d’atteindre les limites de l’espace disque alloué. Flexdrive, une fonction unique de ISIS, est un outil qui permet de redimensionner dynamiquement le stockage, en plus ou en moins d’espace, et ceci à la volée, et selon les besoins. Cette flexibilité est particulièrement unique car elle peut se faire tout en maintenant le système opérationnel et fonctionnel, et elle n’est limitée que par la taille du groupe de stockage: personne n’a donc besoin d’arrêter de travailler durant un changement de configuration.

Workflows à distance

Dans un monde de budgets et de plannings compressés, les équipes ont besoin de pouvoir accéder aux médias où que l’on soit. Avid Interplay permet à l’équipe entière, et pas seulement au monteur, de contrôler et visualiser les rushes sur des terminaux populaires de type iPad, iPhones, et même dans des navigateurs web standard comme Safari ou Chrome. Avec des ratios de prise de vues élevés, dérusher est un travail à temps plein et il peut désormais être fait à distance à partir d’une simple interface web. Lorsqu’un monteur ou un assistant a besoin de monter sur un lieu de tournage avec Avid Media Composer, l’option Sphere de Interplay diffuse en streaming des versions proxy ou compressées des médias haute résolution, sur des réseaux à faible bande passante comme le WiFi ou la 4G. Dans ce type de workflow, les monteurs peuvent mélanger dans la même timeline des médias haute résolution stockés en local, juste acquis sur le tournage, avec des médias en stockage partagé dans les locaux de (post)production. Les rushes peuvent automatiquement être transférés vers la postproduction en tâche de fond pour un travail à distance et sans obstacles.

Solutions de finalisation Haute Résolution

Pour les programmes exigeant des sorties en haute résolution, comme une diffusion cinéma 2K ou 4K, les métadonnées sont un élément important pour conformer de manière fluide et sans obstacles la séquence finale en fichiers haute résolution. Avid Media Composer produit un fichier AAF (Advanced Authoring Format) qui peut être conformé par de nombreux systèmes de finishing. Ce fichier standard contient toutes les informations nécessaires pour confirmer et finaliser un programme, sur un grand nombre de systèmes de finishing haute résolution, notamment :

- Autodesk : Smoke, Flame, Lustre

- BlackMagic Design : Resolve

- Digital Vision : Nucoda

- FilmLight : Baselight

- Quantel : Pablo

Typiquement, la sortie pour une diffusion cinéma est un fichier DCP (Digital Cinema Package), un fichier très gros, en 4K.

Mais au fur et à mesure que la UHDTV arrive, les exigences en format de sortie pourraient devenir un codec efficace comme le HEVC (High Efficiency Video Coding), également connu sous les noms de H265 ou codec Google VP9. Pour la diffusion TV et la distribution de contenu sur Internet, il semble essentiel que la bande passante soit réduite.

Directions futures

Il est clair que la UHDTV est destinée à devenir un format standard de distribution pour les spectateurs du futur. Les formats Blu-ray et les codecs de streaming et téléchargement (H265) sont tout sauf standardisés, et les pipelines de distribution sont en cours de conception et de discussion. A mesure que cette nouvelle évolution des médias commence à arriver, Avid développe activement son infrastructure en amenant toutes ses applications vers le 64 bits, pour des performances accrues, tout en créant une plateforme média modulaire, avec des composants communs partagés par tous les produits Avid et ouverts aux développeurs et fabricants extérieurs. Gérer un pipeline haute résolution nécessite d’inclure tous les niveaux de production, postproduction et distribution. A cette fin, Avid continue de développer une plateforme média conçue pour supporter de telles résolutions et pour acompagner les métadonnées le long du workflow complet.

Les futures versions de Media Composer seront indépendantes de la résolution, gèreront des images au delà du 4K, mais aussi des couleurs et des cadences tout le long du pipeline de postproduction. En même temps, des gains d’efficacité peuvent être obtenus en automatisant les processus et en envoyant certains en arrière plan lorsque cela est faisable (par exemple redimensionner automatiquement une image en utilisant les métadonnées réglées par le directeur photo sur le tournage). Tout au long de ce développement, Avid travaillera de manière ouverte avec ses partenaires pour fournir les meilleures solutions possibles pour nos clients communs, avec le but de ne pas ajouter de contraintes sur les processus efficaces déjà mis en place, et en travaillant avec ces nouveaux formats très stimulants.

Conclusions

Les images haute résolution permettent aux créateurs de fournir des contenus de meilleure qualité, et ainsi de proposer des stimulations sophistiquées pour que les consommateurs agissent : que ce soit en achetant une version de leur programme favori en haute résolution, ou en achetant un nouveau terminal pour en profiter, ou encore en étant face à une publicité de qualité… l’acquisition et la distribution haute résolution continueront d’évoluer. Afin de pouvoir assumer les défis de ces nouveaux formats et des exigences de leur distribution, Avid a une approche holistique en faisant évoluer sa plateforme média pour supporter toutes les étapes et niveaux d’un pipeline de production moderne, de l’éditorial et du stockage, jusqu’à la gestion de données, la visualisation et l’approbation.

Pour répondre aux besoins des productions travaillant aujourd’hui avec des projets haute résolution, les produits Avid ont vu leurs outils et leur technologie améliorés pour permettre aux monteurs et assistants de travailler directement avec des médias haute résolution, sans sacrifier l’efficacité du workflow actuel. De nombreuses productions continueront de fournir des masters HD dans le futur proche, tandis que la demande de contenu UHDTV va évoluer pour faire partie des spécifications de sortie de certains diffuseurs. Avid continuea à fournir des workflows testés et garantis pour que les créateurs et distributeurs profitent des bénéfices du travail en médias haute résolution, avec les programmes HD actuels, tout en développant activement des solutions adaptées aux défis futurs des workflows haute résolution.

Merci aux équipes Avid pour l’écriture de ce document de qualité sur la UltraHD et les workflows actuels et futurs.

L’ensemble des données (textes et images) de ce document appartiennent à Avid Technology Incorporation (USA), que nous avons adaptées en français pour mieux aider les professionnels francophones aux transformations du broadcast.