OBJECTIFS DE LA FORMATION

Cette formation de 5 jours est une initiation avancée et intensive aux outils IA génératifs et correctifs d’images open-source, sous ComfyUI et avec InvokeAI.

ComfyUI est la plateforme IA d’outils génératifs open source la plus puissante et flexible existante, et qui nécessite un apprentissage assez long.

En 5 jours on pourra parvenir à un bon niveau de compréhension et de maîtrise de ComfyUI, pour créer et transformer des images fixes :

- découvrir ComfyUI, sous ses différentes formes : Flux, Z-image, Flux2, Nano Banana, Seedream…

- maîtriser la génération d’images avec ComfyUI, outil principal, à l’interface nodale complexe mais souple

- développer des prompts sophistiqués, les mélanger, utiliser des librairies et styles

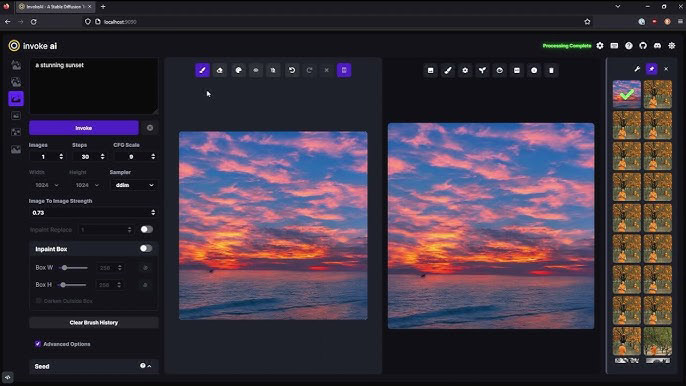

- utiliser InvokeAI, outil complémentaire parfait pour les retouches et composites complexes et créatifs

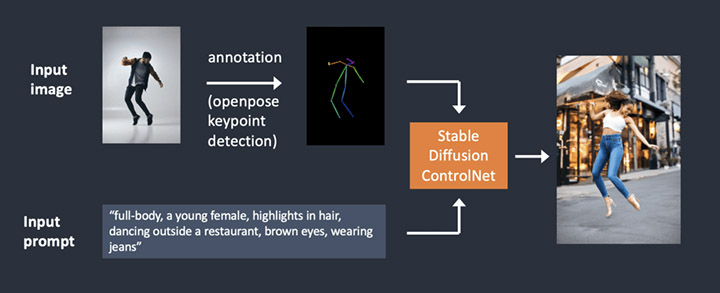

- utiliser ControlNet pour les poses et compositions et Ipadapter pour les styles

- utiliser des LLM avec Ollama pour créer des prompts avancés

- Utiliser les nodes API dans ComfyUI pour accéder à Nano Banana, Seedream, Kling…

La formation croisera prompts de textes imaginaires, références d’images réelles, stylisations, dessins et rendus non réalistes…

NOTA BENE : cette formation nécessite d’avoir déjà une pratique d’IA génératives (Dall-E, MidJourney…), idéalement de connaître des applications à interface nodale, ou au minimum d’être très l’aise avec les outils informatiques !

Objectifs de la formation :

- Découvrir les principes de l’IA générative avec ComfyUI

- Sélectionner les outils adaptés à un projet : Flux, ControlNet, Nano Banana.

- Installer et paramétrer ComfyUI, l’interface nodale

- Ecrire des prompts, de manière avancée

- Agrandir des images avec différentes méthodes

- Modifier, transformer une image

- Générer une image depuis un dessin

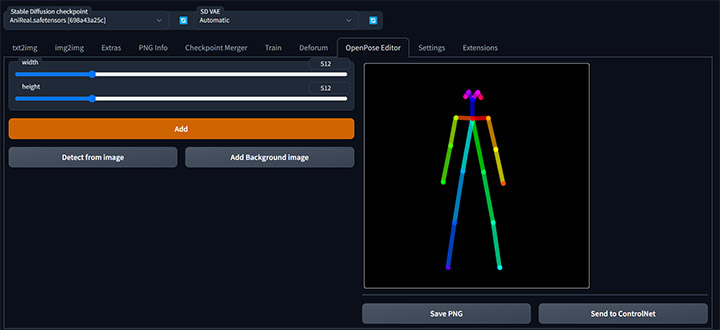

- Gérer des poses avec OpenPose

- Comprendre et utiliser Depth, Canny, Scribble

- Gérer ControlNet de manière avancée

- Savoir gérer la stylisation avec les Ipadapter

- Utiliser InvokeAI, l’outil parfait pour mieux contrôler ses créations

- Utiliser l’inpaint pour modifier profondément une image, réelle ou créée par IA

- Faire de l’Outpaint pour agrandir une image en créant de la matière

- Créer des composites complexes avec photobashing

- Intégrer des objets ou des personnages dans une image IA en respectant le style

- Réaliser des packshots automatiques et évolutifs de produits, parfums, voitures…

- Evaluer et réviser des contenus générés

- Evaluer les IA et leurs résultats en terme de biais, éthiques, écologiques et règlementaires

INSCRIPTION PAR LE CPF ? inscrivez-vous directement sur la plateforme MonCompteFormation !!!!

TEST DE CERTIFICATION inclus uniquement en cas de financement CPF.

Pour tout autre moyen de financement (France Travail, Opco, fonds propres…), la formation n’incluera pas le passage du test de certification.

FORMATEUR PRINCIPAL Lionel Vicidomini, graphiste, motion designer, expert en workflows et IA générative, formateur et créateur de nombreux tutos sur la 3D, l’intelligence artificielle, le motion design… ou Greg Stern, ou Julien Gouz. Tous trois sont experts certifiés en IA générative, graphistes expérimentés et formateurs réguliers.

Présentation de l'outil

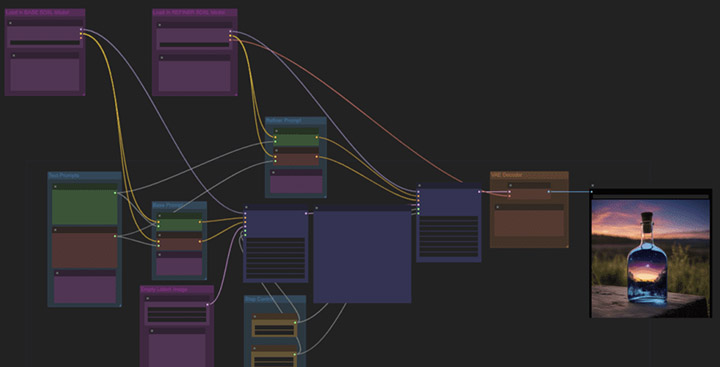

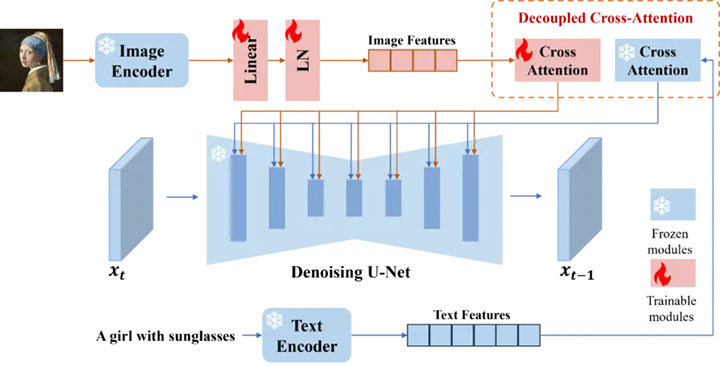

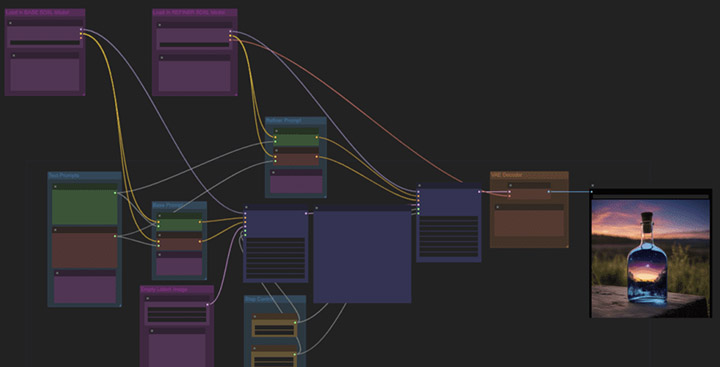

ComfyUI est un outil open source et gratuit permettant de générer et de transformer des images à l’aide de modèles d’IA générative. Il fonctionne comme une interface nodale, dans laquelle la génération repose sur l’enchaînement de blocs (nodes) représentant chaque étape du processus : chargement des modèles, gestion des prompts, contrôle des paramètres, transformation et sortie des images.

Fonctionnant en local ou sur serveur, ComfyUI s’appuie sur les ressources matérielles disponibles (processeur, carte graphique, mémoire), ce qui permet un contrôle fin des performances, des données et des workflows. Grâce à son architecture ouverte et modulaire, ComfyUI est aujourd’hui considéré comme l’outil open source de référence pour la génération d’images par IA, offrant une flexibilité et une puissance supérieures aux solutions propriétaires fonctionnant uniquement en ligne.

Outil gratuit et fonctionnant en local, ComfyUI s’appuie sur les ressources hardware de votre PC, dont la puissance et les performances de calcul déterminent les temps de calcul, parfois très longs, surtout pour des séquences vidéo. Notre formation bénéficie de nos puissantes stations Windows : cartes graphiques NVidia RTX 5090 avec 32 Go de VRam, processeur AMD Ryzen 9900 Max à 5,6 Ghz, mémoire vive 64Go, stockages SSD…

La formation aborde ComfyUI comme outil central d’orchestration, capable d’intégrer des modèles locaux, des services distants et des API externes au sein de workflows cohérents et évolutifs.

ComfyUIest une interface nodale, complexe mais très flexible pour générer des images. On construit des images en chaînant différents blocs (des nodes / nœuds). C’est l’interface la plus populaire et la plus puissante.

Modèles de génération nouvelle génération (Flux, Flux2, Z-Image, Nano Banana, Seedream)

Les modèles de nouvelle génération tels que Flux, Flux2, Z-Image, Nano Banana et Seedream représentent une évolution majeure des modèles de génération d’images. Ils permettent une meilleure compréhension des prompts, une plus grande cohérence visuelle et une qualité de rendu accrue, aussi bien en génération d’images qu’en transformation à partir d’images existantes. Ces modèles peuvent être utilisés localement ou via des services distants, selon les cas, et s’intègrent dans ComfyUI comme des briques spécialisées. La formation explore leurs spécificités, leurs cas d’usage et les différences de rendu afin de choisir le modèle le plus adapté à chaque objectif créatif.

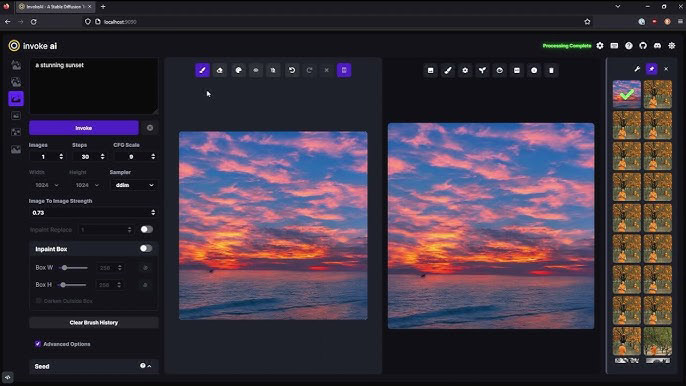

InvokeAI est un outil complémentaire à ComfyUI, orienté vers la retouche manuelle et la composition d’images générées par IA. Son interface, plus proche d’un logiciel de retouche graphique, permet d’intervenir directement sur les images produites : corrections ciblées, photobashing, extension de décors, ajout ou modification d’éléments. InvokeAI est particulièrement adapté aux phases de finition et de création avancée, lorsque l’intervention humaine devient essentielle pour affiner une image, respecter une intention artistique précise ou produire des composites complexes. La formation montre comment intégrer InvokeAI dans un workflow global, en aller-retour avec ComfyUI.

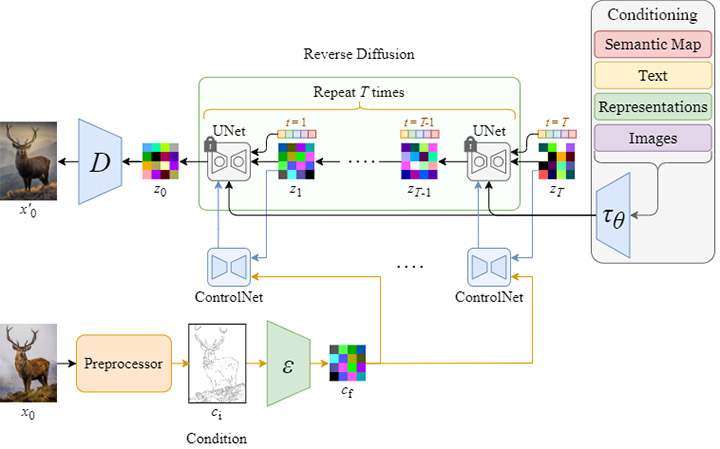

ControlNet est un ensemble de techniques permettant de contrôler finement la génération d’images à partir de structures existantes. Il agit en contraignant la génération selon des informations extraites d’images de référence : poses humaines, contours, profondeur, segmentation ou composition globale. Grâce à ControlNet, il est possible de reproduire une pose précise, de transformer un dessin en image réaliste, de modifier un paysage ou un intérieur, ou encore de guider la structure d’une image tout en conservant la créativité du modèle. La formation aborde ControlNet comme un outil de contrôle et de composition, intégré dans des workflows modernes.

IPAdapter permet d’exploiter une image comme référence visuelle directe afin d’influencer le style, l’apparence ou l’ambiance d’une nouvelle génération. Cette approche, parfois appelée visual prompting, facilite la création de variations stylistiques, le transfert de palettes chromatiques ou la fusion de styles issus de plusieurs images. Utilisé seul ou en combinaison avec ControlNet, IPAdapter permet de maintenir une cohérence visuelle tout en explorant différentes compositions et interprétations créatives. La formation présente IPAdapter comme un outil dédié au travail sur le style et l’identité visuelle.

Modèles de langage (LLM) avec Ollama

Les LLM (Large Language Models) utilisés via Ollama permettent d’exécuter localement des modèles de langage pour assister la création de prompts. Ils peuvent être employés pour générer, structurer, reformuler ou enrichir des descriptions textuelles complexes, adaptées aux modèles d’image. L’intégration des LLM dans le workflow permet d’automatiser certaines tâches rédactionnelles, d’explorer des variations de prompts et d’améliorer la précision des requêtes adressées aux modèles de génération d’images.

Nodes API dans ComfyUI

Les nodes API de ComfyUI permettent de connecter l’interface à des services d’IA externes accessibles via Internet. Ils transforment ComfyUI en un véritable hub d’orchestration, capable de combiner modèles locaux et services distants dans un même workflow. La formation aborde l’utilisation de ces nodes pour accéder à des solutions telles que Nano Banana, Seedream, Kling, et autres services compatibles, tout en expliquant les principes de fonctionnement, les limites et les bonnes pratiques liées à l’usage des API.

CONTENU COMPLET DE LA FORMATION

COMPRENDRE L’IA GENERATIVE AVEC COMFY UI

Présentation de l’IA générative image et de ses usages professionnels

Positionnement de ComfyUI comme outil central d’orchestration des IA génératives

Présentation des modèles de nouvelle génération :

Flux et Flux2

Z-Image

Nano Banana

Seedream

Différences entre modèles locaux, modèles distants et accès via API

Installation et configuration de ComfyUI

Installation et configuration du manager

Présentation des nodes custom les plus couramment utilisés

Découverte et prise en main de l’interface nodale

Compréhension de la logique de workflow (chargement, traitement, génération)

Premières générations d’images avec ComfyUI

LE PROMPT / PRODUIRE DES CONTENUS AVEC DES REQUETES COMPLEXES : DIALOGUER AVEC UNE IA GENERATIVE

Rôle et structure d’un prompt dans la génération d’images

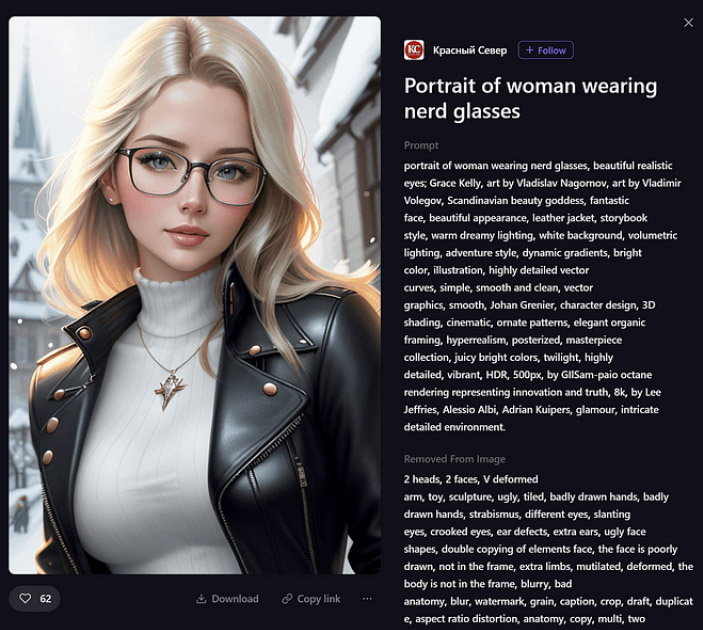

Bonnes pratiques d’écriture de prompts

Prompts descriptifs, stylistiques et narratifs

Notions de seed, steps et paramètres de génération

Compréhension des samplers et de leur impact sur le rendu

CFG : équilibre entre respect du prompt et liberté de génération

Emphase positive et négative

Combinaison et concaténation de prompts

Utilisation de styles et de bibliothèques de prompts

Récupération et analyse de prompts depuis une image existante

Utilisation d’outils d’IA pour assister l’écriture de prompts

Introduction à l’usage de LLM via Ollama pour générer, enrichir et structurer des prompts avancés

AGRANDIR ET AMELIORER DES IMAGES

Principes de l’upscaling et de l’amélioration d’image

Différence entre image latente et image finale

Présentation des principaux nodes d’upscale dans ComfyUI

Utilisation des upscalers

Notion de High Resolution Fix

Méthodes d’agrandissement progressif

Combinaison de plusieurs techniques d’amélioration

Comparaison des résultats selon les modèles utilisés

GENERATION A PARTIR D’UNE IMAGE

Améliorer une image générée

Amélioration d’images issues du Txt2Image

Correction de défauts visuels

Ajustement du style et du rendu

Inpainting et retouches ciblées

Réparation de zones avec l’Inpaint

Ajout ou modification d’éléments

Gestion des masques

Inpaint Sketch pour guider les retouches

Depuis une image externe

Importation d’images dans ComfyUI

Transformation de style

Ajout de détails

Agrandissement d’images

Itérations successives à partir d’une image de référence (loopback)

CONTROLER LA GENERATION AVEC CONTROL NET

Présentation et rôle de ControlNet

Cas d’usage principaux de ControlNet

Poses et Structures

Utilisation d’OpenPose

Extraction de poses depuis des images

Utilisation de poses issues d’autres logiciels

Création et modification de poses

Transfert de poses entre images

Dessins, contours et lignes

Scribble, SoftEdge, Canny, Lineart

Transformation d’un dessin en image réaliste

Transformation d’une photo en illustration

Contrôle des expressions et des lignes directrices

Profondeur et segmentation

Utilisation de la depth map

Structuration de paysages et d’environnements

Segmentation (Seg) pour modifier des zones spécifiques

Ajout et modification d’éléments via masques

Combinaison de plusieurs ControlNet dans un même workflow

Styles et transfert d’apparence avec ipadadpter

Présentation du rôle d’IPAdapter

Application du style d’une image à une autre

Création de styles hybrides

Transfert de palettes chromatiques

Variation de points de vue et de compositions

Association d’IPAdapter avec ControlNet

Photobashing et compositions complexes

INVOKEAI

Présentation d’InvokeAI et de ses usages complémentaires à ComfyUI

Positionnement d’InvokeAI dans un workflow global

Retouches manuelles et précises

Photobashing et composites complexes

Extension de décors avec l’outpainting

Ajout d’objets ou de personnages en respectant le style

Enrichissement de détails par esquisse

Allers-retours entre ComfyUI et InvokeAI

COMFYUI COMME HUB D’IA : UTILISATION DES API

Présentation des nodes API dans ComfyUI

Connexion à des services d’IA externes

Utilisation de Nano Banana via API

Utilisation de Seedream via API

Introduction à l’accès à des outils comme Kling

Logique d’orchestration multi-IA dans un même workflow

Bonnes pratiques pour combiner modèles locaux et services distants

Produire des contenus, les évaluer, réviser et améliorer prompts et réglages.

Evaluer et adapter la méthodologie.

Maximiser qualité et pertinence des productions.

Pour les stagiaires participant à la formation par le biais CPF et avec la certification CertifiAG, des moments spécifiques permettront la préparation des livrables attendus.

Les exercices pratiques, ateliers personnels notamment, seront l’occasion de flécher les compétences à valider et permettront de préparer au mieux le passage de la certification.

ACCOMPAGNEMENT PERSONNALISE

En cours de formation (avant dernier jour en général), un entretien individuel est l’occasion de faire le point sur l’atteinte partielle des objectifs de chaque stagiaire, des lacunes possibles et objectifs ou projets souhaités, leur mise en œuvre possible dans le cadre de la formation.

L’IA, BIAIS, DROITS, CONFORMITE REGLEMENTAIRE

Questions des droits (les milliards d’images référencées, digérées… risques encourus ? peut-on identifier des sources ?) et droits en amont (mes créations m’appartiennent-elles ? à des sociétés d’IA ?)

Problématiques des biais des IA génératives.

Ethique et éco-responsabilité : enjeux sociaux et écologiques, empreinte carbone. Comparaisons entre IA générative. Faire du prompt « raisonnable ».

Connaissance de l’IA act et des règles/lois en vigueur.

Problématiques de confidentialité : entraînement de modèles, partage de créations et sources de clients. Quelle modalités techniques et quelles IA génératives protègent les sources et droits (droits d’auteurs, droits commerciaux) ?

CONDITIONS DE LA FORMATION

MOYENS TECHNIQUES

6 stagiaires maximum. station Windows avec processeur et carte graphique puissants (carte NVidia RTX 5090 avec 32 Go de VRam, processeur AMD Ryzen 9900X Max à 5,6Ghz, 64 Go de RAM), écran 27 pouces. Tablette graphique.

PARTICIPANTS

Graphistes, responsables communication, truquistes, photographes, artistes, réalisateurs.rices, DA, technicien.ne.s, toute personne ayant besoin de se former à la génération et transformation d'images avec l'outil IA opensource non censuré, ComfyUI.

NIVEAU REQUIS

Bonne connaissance de l’informatique. Notions de graphisme (profondeur d’image, pixel, formats, ratios...). Culture artistique. Pratique d'IA génératives (Midjourney, DallE...). Idéalement, pratique d'un outil nodal (3D, VFX)... Pratique régulière d'un outil multimédia. Entretien pédagogique.

Prérequis supplémentaires en cas de financement "CPF" (certification CertifiAG) : Bac+2 ou niveau équivalent, expérience professionnelle en image de 6 mois minimum

ACCESSIBILITÉ

Nos formations sont accessibles et aménageables pour les personnes en situation de handicap. Fauteuils roulants autorisés en largeur maxi 70cm. Pour tout handicap, auditif, visuel ou autre, merci de nous contacter pour les aménagements possibles.

VALIDATION DES ACQUIS

Contrôle continu tout au long de la formation, exercé par le formateur et supervisé par la responsable pédagogique. Délivrance d'un Certificat de Validation des Acquis de Formation. (en savoir plus)

En cas de financement « CPF », cette formation inclut la préparation et le paiement du test de certification : « Produire et réviser du contenu professionnel multimédia en utilisant les outils d’Intelligence Artificielle Générative (IAG) de façon responsable »

Cette certification est enregistrée au Répertoire spécifique de France Compétences : RS6891 (Certificateur : CERTIFOPAC / 28.11.2024 – 28.11.2027).

C’est l’organisme certificateur, Certifopac, qui évaluera les compétences acquises par les candidats. Afin de valider la certification, les apprenants doivent démontrer leur capacité à mettre en application les compétences du référentiel de certification, à savoir :

- Choix des outils IAG : capacité à sélectionner les technologies pertinentes en fonction des besoins

- Interaction avec l’IAG : aptitude à dialoguer efficacement avec l’IA pour obtenir des résultats optimaux

- Création de contenus : maîtrise des méthodes de production adaptées aux objectifs métier

- Optimisation des contenus : application des techniques d’amélioration des résultats générés par l’IA

- Considérations éthiques et réglementaires : prise en compte des biais, de la confidentialité et de la conformité légale pour concevoir sa solution métier

- Plus d’informations sur le référentiel de compétences ici : https://drive.google.com/file/d/1f3r0QGgvu28sZ-1x3Quu2SJbz4B3gA3-/view

Le processus d’évaluation se déroule en 2 étapes :

- Une épreuve écrite : Rédaction d’un rapport, de 10 pages maximum, détaillant un cas pratique, réel ou fictif, en lien avec les outils d’IAG. Démonstration des compétences C1 à C4. Dépôt du rapport via WEDOF au moins 15 jours avant la soutenance

- Une épreuve orale : Présentation de 20 minutes en visioconférence devant un jury. Temps d’exposé : 10 minutes pour présenter les résultats obtenus. Questions du jury : 10 minutes pour valider la compétence C5 Le Bahut se charge de votre inscription à la certification auprès de Certifopac.

- Le coût d’un passage est inclus dans le tarif de la formation.

- Pour en savoir plus sur les modalités d’inscription, d’évaluation et de certification : https://certifopac.fr/certifiag/candidature/

MODALITES D'ORGANISATION

Formation présentielle, en nos locaux, 13 rue Desargues, 75011 Paris.

MOYENS ET MODALITES PEDAGOGIQUES

Une salle de formation avec tableau blanc, un poste informatique pour chaque apprenant, un poste informatique vidéo-projeté pour les formateurs, avec accès internet et imprimante partagée. Alternance de séquences théoriques et d'exercices d'application réelle. Les exercices sont réalisés sous la supervision des formateurs, dans une logique d'apprentissage des compétences et d'autonomie progressive des apprenants. Des exercices plus longs et synthétiques permettent de reprendre un ensemble de compétences dans des cas pratiques types des métiers et compétences concernés, et s'assurer de leur acquisition par les apprenants.

SUPPORT DE COURS

1 mémo sur ComfyUI

SUIVI DE STAGE

Gratuit par email

RESP. PÉDAGOGIQUE

James Simon

FORMATEUR

Professionnel en activité, expert certifié CertifiAG, reconnu dans son domaine, animant régulièrement des formations.

LABELS QUALITÉS

Centre certifié Qualiopi (certification nationale) / référencé Data-Dock / centre certifié Blackmagic Design / centre de test Certiport