OBJECTIFS DE LA FORMATION

Cette formation IA générative est un perfectionnement de 5 jours sur ComfyUI, pour gérer / générer vidéo, mais aussi 3D et workflows VFX avancés.

ComfyUI est l’outil de référence dans la création de contenu IA open-source avancé. Depuis quelques mois, de nouveaux outils de création vidéo (WAN, LTX etc…) permettent la création illimitée, gratuite et non censure de vidéo sur votre ordinateur personnel.

ComfyUI est également de plus en plus utilisé par des studios VFX qui s’en servent pour rotoscopie, keying, isolation d’éléments, mais également création avancée de passes pour le compositing, relighting…

ComfyUI peut également créer des modèles 3D à partir de prompts, d’images, pour ensuite les intégrer dans des workflows avancés, où l’on mêlera création d’images, de modèles 3D et de vidéos pour créer des séquences, avec un contrôle complet.

Enfin, ComfyUI permet l’accès par API à tous les grands modèles de création payants, tels que Kling, RunWay, ChatGPT-io pour enrichir l’arsenal créatif et permettre des mélanges et fusion dans une seule interface

En 5 jours, cette formation avancée couvrira ces principaux objectifs :

- Maîtriser les bases de ComfyUI : installation, modules essentiels, compréhension des principes de “workflow”

- Créer des images fixes avec SDXL, Flux, HiDream, des modèles locaux

- Créer des images fixes avec les API, pour Flux Kontext, Flux Ultra, ChatGPT-IO, Veo

- Produire des vidéos avec des modèles locaux tels que LTX, WAN

- Maîtriser les contrôles avancés de création vidéo :

- Transfert de style

- Copie de mouvement par ControlNet

- Faceswap

- Produire des passes de relighting : normales, profondeur, segmentation…

- Créer des vidéos par API, avec Kling, Runway, Veo

- Créer des modèle 3D par modèles locaux, avec Hunyan3D

- Gérer des Modèles 3D par API, avec Tripogen

- Mettre en places des workflows avancés de mélange de différentes techniques pour création de vidéo

INSCRIPTION PAR LE CPF ? inscrivez-vous directement sur la plateforme MonCompteFormation !!!!

FORMATEUR PRINCIPAL Lionel Vicidomini, graphiste, motion designer, expert en workflows et IA générative, formateur et créateur de nombreux tutos sur la 3D, l’intelligence artificielle, le motion design… ou Greg Stern, ou Julien Gouz. Tous trois sont experts certifiés en IA générative, graphistes expérimentés et formateurs réguliers.

Objectifs complets de la formation :

- Maîtriser les principes de l’IA générative avec ComfyUI

- Sélectionner les outils adaptés à un projet : SDXL, Flux, InvokeAI, ControlNet, PullD…

- Maîtriser les bases de ComfyUI : installation, modules essentiels, compréhension des principes de “workflow”

- Ecrire des prompts, de manière avancée

- Créer des images fixes avec SDXL, Flux, HiDream, des modèles locaux

- Créer des images fixes avec les API, pour Flux Kontext, Flux Ultra, ChatGPT-IO, Veo

- Produire des vidéos avec des modèles locaux tels que LTX, WAN

- Maîtriser les contrôles avancés de création vidéo :

- Transfert de style

- Copie de mouvement par ControlNet

- Faceswap

- Produire des passes de relighting : normales, profondeur, segmentation…

- Créer des vidéos par API, avec Kling, Runway, Veo

- Créer des modèle 3D par modèles locaux, avec Hunyan3D

- Gérer des Modèles 3D par API, avec Tripogen

- Mettre en places des workflows avancés de mélange de différentes techniques pour création de vidéo

- Evaluer et réviser des contenus générés

- Evaluer les IA et leurs résultats en terme de biais, éthiques, écologiques et règlementaires

Présentation de l'outil

ComfyUI est la pierre angulaire de cette formation IA générative open-source avancée ComfyUI.

ComfyUI est une interface nodale qui permet d’utiliser un très grand nombre d’architectures IA et leurs modèles, ainsi que tous leurs différentes outils. ComfyUI est le premier choix de la communauté de développeurs et chercheurs en IA qui testent leurs modèles sur cette interface professionnelle et en perpétuelle évolution.

Outil gratuit et fonctionnant en local, ComfyUI s’appuie sur les ressources hardware de votre PC, dont la puissance et les performances de calcul déterminent les temps de calcul, parfois très longs, surtout pour des séquences vidéo. Notre formation bénéficie de nos puissantes stations Windows : cartes graphiques NVidia RTX 5090 avec 32 Go de VRam, processeur AMD Ryzen 9900 Max à 5,6 Ghz, mémoire vive 64Go, stockages SSD…

Open-source et gratuit, ComfyUI a été très largmement adoptée par la communauté de créateurs IA. Comme elle n’appartient à aucune société et que son développement est largement communautaire, ComfyUI est à la pointe de l’innovation.

Depuis quelques mois, ComfyUI s’est ouvert aux autres architectures d’ia génératives, fermées et commerciales, telles que ChatGPT Image, Google VEO, Recraft,… offrant ainsi un choix presque infini, regroupé sous une seule interface.

On commencera avec la création d’image fixe, qui reste souvent la première étape indispensable pour tout flux de travail.

SDXL, Flux, HiDream sont les modèles locaux qui sont utilisés et qui permettent une très grande liberté de création avec un maximum de contrôle.

Comme ce sont des modèles locaux, cela veut dire que leur utilisation est hors-ligne, illimitée, et gratuite (hors la consommation électrique de l’ordinateur).

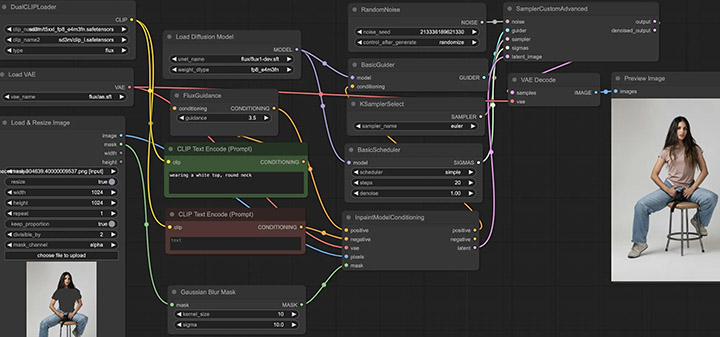

Ces modèles donnent également un très grand contrôle créatif sur l’image : ajout d’élément ou changement de détail avec le inpaint, transfert ou application de style avec les IP-Adapter, contrôle de la pose ou de la structure de l’image avec les Control-Net

Pour aller encore plus loin on peut utiliser en plus tous les modèles fermés concurrentiels : on paye à l’unité, pour employer par exemple ChatGPT image, Flux Kontext ou Google Veo.

Avec ces images créées sur mesure on attaquera ensuite la création de vidéos avec des modèles locaux tels que LTX, très rapide à calculer, ou WAN, de très grande qualité mais un peu plus lent.

Ces modèles permettent un grand contrôle dans la vidéo, avec des outils similaires à ceux de la création d’image.

Là aussi, on peut préférer utiliser les modèles fermés concurrents tels que Kling, Runway, Veo etc…

Cette formation aborde également les outils de compositing avancé, que les studios d’effets spéciaux utilisent de plus en plus : création de normales pour le relighting, de passes de profondeur pour l’ajout de bokeh ou d’atmosphère.

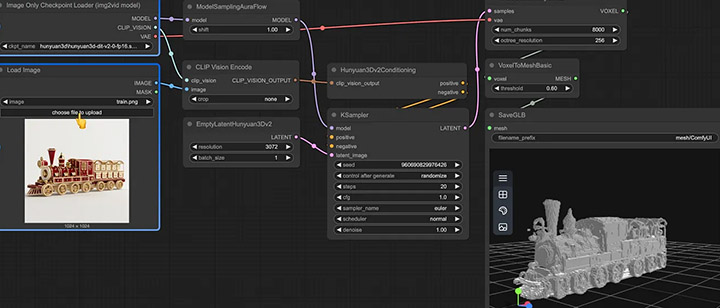

Enfin la création de modèle 3D est également étudiée avec les modèles locaux ou en ligne, ce qui permet des mélanges intéressants :

Création d’une image fixe, puis stylisation, pour ensuite générer certains éléments sous la forme de modèle 3D, pour créer d’autres générations d’images. Ensuite création de vidéo intégrant ces différents éléments pour contrôler l’aspect, la structure, et les éléments de la vidéo. Enfin, correction de ces vidéos grâce aux outils de post-production.

CONTENU COMPLET DE LA FORMATION

MAITRISER L’IA GENERATIVE AVEC COMFY UI (RAPPELS)

-

- ControlNet

- IpAdapter

- Inpaint

- Outpaint

PRODUIRE DES CONTENUS AVEC DES REQUETES COMPLEXES : DIALOGUER AVEC UNE IA GENERATIVE (RAPPELS)

Le checkpoint : utilisation de CivitAI pour découvrir et utiliser d’autres modèles

Concept du Token. Seed et Steps. Le Sampler. CFG

Emphase positive et négative.

S’aider d’autres IA pour écrire des prompts. Récupérer un prompt depuis une image. Etc.

GENERATION VIDEO AVEC COMFYUI

-

- Génération de morph avec Steerable Diffusion

- Modèle LTX video pour la vitesse

- Text2video

- Img2video

- Optimisations de vitesse : quantization, lora

- Modèle Wan-Vace

- Animer une image

- Remplacer un sujet par un autre

- Générer une vidéo selon le style d’une image

- Etendre les bords d’une vidéo

- Contrôle de mouvement de caméra avec Uni3C

- En utilisant un node 3D pour créer une animation de caméra

- Contrôle de mouvement de l’image avec ATI

- Agrandir une vidéo

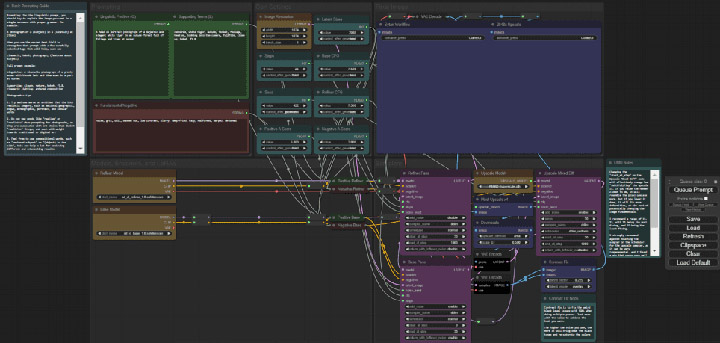

VIDEO AVANCEE

Manipulations avancées de vidéo avec ComfyUI

-

- Créations et manipulations de normales depuis une vidéo avec NormalCrafter

- Exemples d’applications dans Resolve

- Comme source de ControlNet

- Zdepth avec DepthCrafter

- Exemples d’application dans Resolve

- Comme source de ControlNet

- Créations et manipulations de normales depuis une vidéo avec NormalCrafter

LA 3D

Génération 3D avec ComfyUI

-

- Hunyuan

- Texte vers modèle 3D

- image vers modèle 3D

- Plusieurs images vers modèle 3D

- Hunyuan

LES API NODES IMAGES

Découverte et utilisation des API nodes images

-

- Flux PRO et Flux Ultra

- Flux Kontext

- OpenAI

- Recraft

LES API VIDEO

Découverte et utilisation des API vidéo

-

- Kling

- Text2video

- Img2video

- VideoEffects

- Runway

- First Last Frame

- Img2video

- Kling

WORKFLOW AVANCES

Workflows avancés mêlant plusieurs générateurs

-

- Génération d’image fixe d’un personnage, d’un décor

- Génération de modèle 3D

- Placement du modèle 3D pour un compositing

- Compositing avec une API vidéo ou local

Produire des contenus, les évaluer, réviser et améliorer prompts et réglages.

Evaluer et adapter la méthodologie.

Maximiser qualité et pertinence des productions.

Pour les stagiaires participant à la formation par le biais CPF et avec la certification CertifiAG, des moments spécifiques permettront la préparation des livrables attendus.

Les exercices pratiques, ateliers personnels notamment, seront l’occasion de flécher les compétences à valider et permettront de préparer au mieux le passage de la certification.

ACCOMPAGNEMENT PERSONNALISE

En cours de formation (avant dernier jour en général), un entretien individuel est l’occasion de faire le point sur l’atteinte partielle des objectifs de chaque stagiaire, des lacunes possibles et objectifs ou projets souhaités, leur mise en œuvre possible dans le cadre de la formation.

L’IA, BIAIS, DROITS, CONFORMITE REGLEMENTAIRE

Questions des droits (les milliards d’images référencées, digérées… risques encourus ? peut-on identifier des sources ?) et droits en amont (mes créations m’appartiennent-elles ? à des sociétés d’IA ?)

Problématiques des biais des IA génératives.

Ethique et éco-responsabilité : enjeux sociaux et écologiques, empreinte carbone. Comparaisons entre IA générative. Faire du prompt « raisonnable ».

Connaissance de l’IA act et des règles/lois en vigueur.

Problématiques de confidentialité : entraînement de modèles, partage de créations et sources de clients. Quelle modalités techniques et quelles IA génératives protègent les sources et droits (droits d’auteurs, droits commerciaux) ?

CONDITIONS DE LA FORMATION

MOYENS TECHNIQUES

6 stagiaires maximum. 1 station Windows avec processeur et carte graphique puissants (carte NVidia RTX 5090 avec 32 Go de VRam, processeur AMD Ryzen 9900X Max à 5,6Ghz, 64 Go de RAM), écran 27 pouces. Tablette graphique.

PARTICIPANTS

Graphistes, truquistes, directeurs artistiques, artistes, réalisateurs.rices, technicien.ne.s, toute personne pratiquant déjà ComfyUI et voulant se perfectionner à ces outils de génération open source, en image, vidéo, 3D et VFX.

NIVEAU REQUIS

Grande aisance avec les outils informatiques. Pratique régulière de ComfyUI. Pratique d'IA génératives (Midjourney...). Idéalement, pratique d'un outil nodal (3D, VFX)...

Prérequis supplémentaires en cas de financement "CPF" (certification CertifiAG) : Bac+2 ou niveau équivalent, expérience professionnelle en image de 6 mois minimum

ACCESSIBILITÉ

Nos formations sont accessibles et aménageables pour les personnes en situation de handicap. Fauteuils roulants autorisés en largeur maxi 70cm. Pour tout handicap, auditif, visuel ou autre, merci de nous contacter pour les aménagements possibles.

VALIDATION DES ACQUIS

Contrôle continu tout au long de la formation, exercé par le formateur et supervisé par la responsable pédagogique. Délivrance d'un Certificat de Validation des Acquis de Formation. (en savoir plus)

En cas de financement « CPF », cette formation inclut la préparation et le paiement du test de certification : « Produire et réviser du contenu professionnel multimédia en utilisant les outils d’Intelligence Artificielle Générative (IAG) de façon responsable »

Cette certification est enregistrée au Répertoire spécifique de France Compétences : RS6891 (Certificateur : CERTIFOPAC / 28.11.2024 – 28.11.2027).

C’est l’organisme certificateur, Certifopac, qui évaluera les compétences acquises par les candidats. Afin de valider la certification, les apprenants doivent démontrer leur capacité à mettre en application les compétences du référentiel de certification, à savoir :

- Choix des outils IAG : capacité à sélectionner les technologies pertinentes en fonction des besoins

- Interaction avec l’IAG : aptitude à dialoguer efficacement avec l’IA pour obtenir des résultats optimaux

- Création de contenus : maîtrise des méthodes de production adaptées aux objectifs métier

- Optimisation des contenus : application des techniques d’amélioration des résultats générés par l’IA

- Considérations éthiques et réglementaires : prise en compte des biais, de la confidentialité et de la conformité légale pour concevoir sa solution métier

- Plus d’informations sur le référentiel de compétences ici : https://drive.google.com/file/d/1f3r0QGgvu28sZ-1x3Quu2SJbz4B3gA3-/view

Le processus d’évaluation se déroule en 2 étapes :

- Une épreuve écrite : Rédaction d’un rapport, de 10 pages maximum, détaillant un cas pratique, réel ou fictif, en lien avec les outils d’IAG. Démonstration des compétences C1 à C4. Dépôt du rapport via WEDOF au moins 15 jours avant la soutenance

- Une épreuve orale : Présentation de 20 minutes en visioconférence devant un jury. Temps d’exposé : 10 minutes pour présenter les résultats obtenus. Questions du jury : 10 minutes pour valider la compétence C5 Le Bahut se charge de votre inscription à la certification auprès de Certifopac.

- Le coût d’un passage est inclus dans le tarif de la formation.

- Pour en savoir plus sur les modalités d’inscription, d’évaluation et de certification : https://certifopac.fr/certifiag/candidature/

MODALITES D'ORGANISATION

Formation présentielle, en nos locaux, 13 rue Desargues, 75011 Paris.

MOYENS ET MODALITES PEDAGOGIQUES

Une salle de formation avec tableau blanc, un poste informatique pour chaque apprenant, un poste informatique vidéo-projeté pour les formateurs, avec accès internet et imprimante partagée. Alternance de séquences théoriques et d'exercices d'application réelle. Les exercices sont réalisés sous la supervision des formateurs, dans une logique d'apprentissage des compétences et d'autonomie progressive des apprenants. Des exercices plus longs et synthétiques permettent de reprendre un ensemble de compétences dans des cas pratiques types des métiers et compétences concernés, et s'assurer de leur acquisition par les apprenants.

SUPPORT DE COURS

1 mémo sur les outils avancés open source, ComfyUI...

SUIVI DE STAGE

Gratuit par email

RESP. PÉDAGOGIQUE

James Simon

FORMATEUR

Professionnel en activité, expert certifié CertifiAG, reconnu dans son domaine, animant régulièrement des formations.

LABELS QUALITÉS

Centre certifié Qualiopi (certification nationale) / référencé Data-Dock / centre certifié Blackmagic Design / centre de test Certiport